LLMs¶

KARLI-gehostete Chat-Modelle sind ein Provider neben den übrigen (OpenAI, Anthropic usw.) und in jeder modell-fähigen Komponente auswählbar — am häufigsten in Language Model und Agent.

Technisch spricht der KARLI-Provider eine OpenAI-kompatible API: Komponenten wählen ein KARLI-Modell genauso wie ein OpenAI-Modell, aber die Requests gehen an den KARLI-Endpoint.

Verfügbare Modelle¶

| Modell | Hinweise |

|---|---|

karli/KARLI-MoE-latest |

KARLI-Standard-Chat-Modell; unterstützt Tool Calling. |

Ein KARLI-Modell auswählen¶

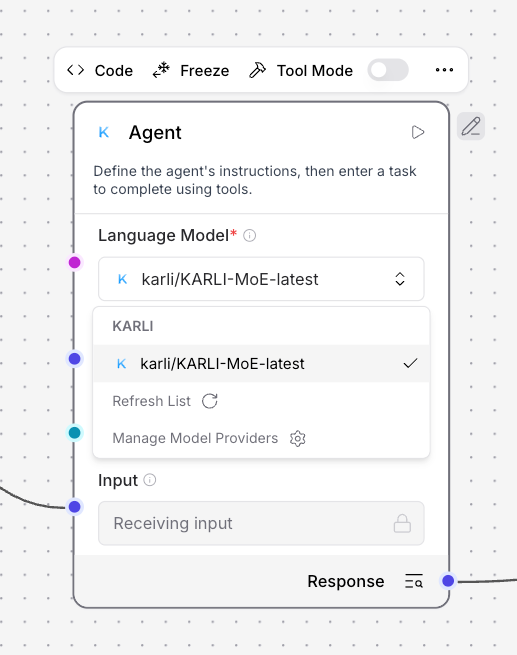

Jede modell-fähige Komponente (z. B. Language Model oder Agent) öffnen, als Provider KARLI wählen und ein Modell aus dem Dropdown picken. Der Provider blendet die in der Modelle-Übersicht beschriebenen Zugangsdaten KARLI_API_KEY / KARLI_BASE_URL ein.

Provider-Filterung¶

Einzelne Agentlab-Dropdowns sind auf einen bestimmten Provider eingegrenzt — zum Beispiel ist der Modell-Selector für die Extraktion in der Read-File-Komponente ausschließlich auf KARLI gefiltert (siehe Datenextraktion). Weitergehende, deployment-weite Provider-Filterung (etwa für Datensouveränität oder Compliance) wird nicht von Agentlab, sondern von der umgebenden Karli-Studio-Plattform durchgesetzt.